Radiometrische Messungen

Radiometrische Messungen für industrielle Prozesse gibt es schon seit einigen Jahrzehnten. Sie sind ein wichtiger Bestandteil bei der Durchführung kritischer Füllstands-, Dichte- und Durchsatzmessungen. Radiometrische Messgeräte funktionieren auch dort, wo herkömmliche Messtechnik versagt. Sie bieten hervorragende Messergebnisse unter extremen Bedingungen.

Hohe Temperaturen, Drücke und andere schwierige Umgebungs- und Prozessbedingungen stellen für radiometrische Messungen kein Problem dar. Typische Messaufgaben sind berührungslose Füllstands- und Dichtemessungen in unterschiedlichsten Behältern, Bunkern und Rohrleitungen, Trennschichtmessungen in Ölabscheidern und die Messung des Feuchtegehalts. Außerdem können sie als berührungsloser Grenzschalter eingesetzt werden.

Was ist eine radiometrische Messung?

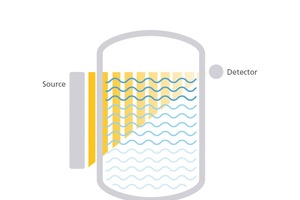

Radiometrische Messgeräte arbeiten nach dem Prinzip der Absorption. Eine typische radiometrische Messstelle besteht aus

einer Quelle, die Gammastrahlen aussendet, die von einem Radioisotop erzeugt werden

einem Behälter oder einer Rohrleitung mit dem zu messenden Produkt

einem Detektor, der in der Lage ist, Gammastrahlung zu detektieren

Wenn sich kein oder wenig Material im Strahlenfeld befindet, ist die Strahlungsintensität stark. Befindet sich beim Durchdringen der Strahlung ein Medium im Messbereich, wird die Strahlungsintensität abgeschwächt. Die vom Detektor erfasste Strahlungsmenge kann zur Berechnung des gewünschten Prozesswerts verwendet werden. Dieses Prinzip gilt für jede radiometrische Messung und liefert dabei präzise und reproduzierbare Messergebnisse. Unter Verwendung der Gesetze der Physik und Statistik sowie mit Hilfe ausgeklügelter Software-Algorithmen sind gammabasierte Messungen nahezu immer erfolgreich. Für eine genaue und reproduzierbare Messung sind jedoch konkrete Auslegungsinformationen unerlässlich. In Anbetracht der Vorteile einer berührungslosen und nichtintrusiven Technologie wird die radiometrische Messtechnik zur Nummer Eins für schwierigste und anspruchsvollste Anwendungen in der Prozessmesstechnik. Allerdings ist jede Messung fehlerbehaftet und so gibt es auch bei radiometrischen Messungen Fehlereinflüsse. Die Ursachen dieser Fehlereinflüsse können aber, unter Berücksichtigung bestimmter Rahmenbedingungen und einer sorgfältigen Auslegung der Messtechnik, unterdrückt oder auf ein vertretbares Maß reduziert werden. In diesem Artikel werden die Art und Ursachen dieser Fehlereinflüsse erläutert und Lösungen aufgezeigt, wie diese durch die Anwendung von „Best Practices” und sachgemäßer Auslegung minimiert werden können.

Strahlenquellen

Es gibt viele bekannte natürliche und künstliche radioaktive Isotope; nicht alle werden jedoch für radiometrische Messungen verwendet. Für industrielle Anwendungen werden nur wenige Nuklide tatsächlich zu Messzwecken eingesetzt. Das radioaktive Isotop befindet sich in der Regel in einer robusten, stahlummantelten Bleiabschirmung, um maximale Sicherheit zu gewährleisten. Diese Abschirmung schirmt die von einem radioaktiven Isotop emittierte Strahlung ab und gibt die Strahlung, nur in Richtung des vorgesehenen Messweges, frei. Mit einer kleinen Öffnung in der Abschirmung kann der kollimierte Strahl in verschiedenen Winkeln in das Rohr oder den Behälter projiziert werden. Dies garantiert eine hohe Messqualität bei minimaler Strahlenbelastung des Personals. Grundsätzlich gilt das ALARA-Prinzip (As Low As Reasonably Achievable) für maximale Arbeitssicherheit für alles, was mit Radioisotopen zu tun hat.

Radioaktivität

Die am häufigsten verwendeten Isotope sind Cäsium-137 und Cobalt-60. Für bestimmte Anwendungen wird manchmal auch Americium-241 eingesetzt. Diese Isotope unterscheiden sich voneinander in Bezug auf deren Halbwertszeit, aber auch durch die emittierte Gamma-Energie. Die Bedeutung von „Aktivität“ und „Energie“ der von einem Strahler emittierten Strahlung kann sehr leicht verwechselt werden:

Aktivität beschreibt die durchschnittliche Anzahl der Kernzerfälle des Isotops, die dazu führen, dass ein Gammaquant emittiert wird. Mit anderen Worten: die Menge an radioaktivem Material.

Jedes Gammaquant hat eine bestimmte Energie. Die Energieverteilung des emittierten Gammaquants ist für jedes Isotop charakteristisch. Die Gamma-Energie steht in direktem Zusammenhang mit der Fähigkeit der Strahlung, Materialien (Medien, Behälter, etc.) zu durchdringen.

Dabei ist es wichtig zu verstehen, dass die Anzahl der emittierten Gammaquanten – und damit die Aktivität – nichts mit ihrer Energie zu tun hat. Ähnlich ist es bei der Farbe des Lichts, die nichts mit ihrer Helligkeit zu tun hat. Auch die Halbwertszeit darf nicht mit der Lebensdauer eines Strahlers verwechselt werden! Die Halbwertszeit eines Isotops ist eine unveränderliche physikalische Eigenschaft des Isotops; sie bezieht sich auf die Zeit, in der sich die Aktivität eines Materials auf die Hälfte reduziert. Radioaktive Strahlenquellen sind typischerweise für eine Lebensdauer von 10 bis 15 Jahren ausgelegt, unabhängig vom verwendeten Isotop. Die Nuklidauswahl für eine bestimmte Messaufgabe richtet sich nach dem zu messenden Medium, aber auch nach dem Aufbau (z. B. Punkt- oder Stabstrahler) und den baulichen Gegebenheiten vor Ort. Der radioaktive Zerfall ist ein stochastischer Prozess und kann daher mit Hilfe statistischer Methoden analysiert werden.

Punktstrahler

Punktstrahler werden für nahezu jede Messaufgabe eingesetzt, sei es für Dichte, Füllstand oder als Grenzschalter. Sie bestehen in der Regel aus einer inneren Strahlerkapsel, die das radioaktive Material sicher einkapselt, und einer Abschirmung mit einem Verschlussmechanismus, der die Strahlung kontrolliert blockiert.

Stabstrahler

Ein Stabstrahler verteilt den aktiven Bereich kontinuierlich über den gesamten Messbereich. Dies kann durch Aufwickeln eines aktivierten Kobaltdrahtes (Co-60) auf einen Träger erfolgen. Einer der Vorteile eines Stabstrahlers ist die Erreichung einer „perfekten“ linearen Kalibrierung (Zählrate vs. Füllstand in %), d.h. die prozentuale Änderung der Zählrate steht in direktem Zusammenhang mit der prozentualen Änderung des Prozesswertes.

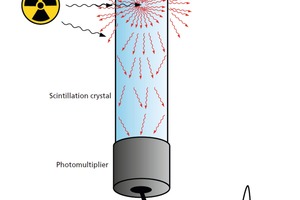

Detektoren

Der Strahlungsdetektor enthält einen Kristall aus einem speziellen Polymermaterial oder einen anorganischen Kristall, wie dotiertes Natriumiodid – den sogenannten Szintillator. Der Szintillator wandelt die einfallende Gammastrahlung in sichtbare Lichtblitze um. Der Kristall ist optisch mit einem Photomultiplier gekoppelt, welcher wiederum das Licht in elektrische Impulse umwandelt. Während der Vakuum-Photomultiplier seit Jahrzehnten erfolgreich eingesetzt wird, stehen heute auch Silizium-Photomultiplier (SiPM) zur Verfügung, die sich in industriellen Detektoren immer mehr durchsetzen. Das Bild oben zeigt schematisch den Aufbau und die Funktionsweise eines Detektors. Treffen die emittierten Gammaquanten, nach Durchdringen der Wände des Behälters, des Rohres und des zu messenden Produktes selbst, auf den Kristall, erzeugt jedes Gamma-Photon einen Lichtblitz, der zu Tausend weiteren Lichtblitzen führt, die letztendlich vom Photomultiplier registriert werden. Jeder Lichtimpuls wird dabei vom Photomultiplier in elektrische Impulse umgewandelt.

Nach der Digitalisierung des Signals werden diese Impulse gezählt, um eine sogenannte Zählrate zu bestimmen, die typischerweise als Impulse pro Sekunde (ips) oder Frequenz (Hz) angegeben wird. Die Unterscheidung zwischen verschiedenen Messaufgaben (z. B. Füllstand oder Dichte) erfolgt im Transmitter bzw. der Steuereinheit. Anhand der Zählrate wird dort ein prozessbezogenes Signal berechnet, das für eine Anzeige, einen analogen Stromausgang oder Busverbindungen zu einem DCS oder SPS verwendet werden kann. Der Detektor misst die gesamte γ-Strahlung, die im Szintillator ankommt, ohne zu unterscheiden, ob die „nützliche Zählrate“ aus dem Strahler oder der natürlichen Hintergrundstrahlung aus der Umgebung stammt. Wir werden später erfahren, wie mit Störstrahlung aus Schweißnahtprüfungen und Veränderungen der natürlichen Hintergrundstrahlung usw. umgegangen werden kann.

Punktdetektoren

Detektoren mit einem kleinen Szintillator werden als Punktdetektoren bezeichnet. Oft wird ein kleiner Zylinder als Szintillator, z. B. mit einem 50 mm Durchmesser und einer Höhe von 50 mm, verwendet. Punktdetektoren werden typischerweise für Dichteanwendungen, aber auch als Grenzschalter oder für kontinuierliche Füllstandsmessungen eingesetzt. Je nach Mess-aufgabe können andere Szintillatorgrößen verwendet werden.

Aufgrund des geringen empfindlichen Volumens eines Punktdetektors wird dieser von der Hintergrundstrahlung nur wenig beeinflusst. Darüber hinaus können Punktdetektoren problemlos mit einem Bleikollimator ausgestattet werden, um so die Empfindlichkeit gegenüber Hintergrundstrahlung weiter zu senken.

Stabdetektoren

In einigen Fällen ist es vorteilhaft, wenn der Szintillator einen größeren Messbereich abdeckt, was mit einem Stabdetektor erreicht werden kann. Typischerweise erstreckt sich bei Füllstandsmessungen entweder der Strahler oder der Detektor über den gesamten Messbereich. Ihre Länge kann dabei bis zu 8 m betragen. Der Hauptvorteil eines Stabdetektors sind seine niedrigeren Kosten im Vergleich zu einem Stabstrahler, der jedoch das technologisch überlegene System wäre. Die Gammastrahlung, die ein Stabdetektor erfassen kann, wird durch die Geometrie des Strahlungsfeldes beeinflusst. Da Stabdetektoren jedoch typischerweise nicht abgeschirmt sind (eine Abschirmung würde den Kostenvorteil mindern), reagieren diese wesentlich empfindlicher auf Veränderungen der natürlichen Hintergrundstrahlung. Dieser Effekt ist gegenüber den meisten anderen Fehlerquellen dominant. Insbesondere muss die Tatsache berücksichtigt werden, dass Schwankungen von ±15 %, durch die Anreicherung von Radon-222 und seiner Zerfallsprodukte, z.B. nach Regen, möglich sind, wie wir später zeigen werden.

Fehlerarten

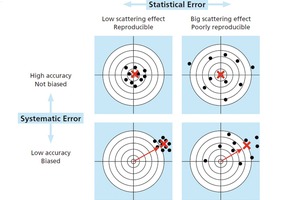

Nachfolgend sollen verschiedene Arten von Fehlern erläutert werden, die bei einer radiometrischen Messung auftreten können. Natürlich denkt man sofort an statistische Fehler, aber es soll gezeigt werden, dass es auch andere Einflüsse gibt, die Fehler verursachen. Messfehler lassen sich in systematische Fehler und statistische (zufällige) Fehler unterteilen. Ein geeigneter Messaufbau liefert ein gutes Ergebnis mit einer angemessenen Genauigkeit und Reproduzierbarkeit. Häufig ist die Reproduzierbarkeit, durchaus innerhalb akzeptabler Toleranzen, wichtiger als die absolute Genauigkeit des Wertes.

Mit diesem Zusammenhang von Genauigkeit und Reproduzierbarkeit im Hinterkopf werden wir in diesem Artikel über das Spezialgebiet der radiometrischen Messung sprechen und einen Überblick geben über:

Verschiedene Arten von Fehlern

Verschiedene Arten von Messsystemen

Wie verschiedene Fehlerarten in verschiedenen Anwendungen dominieren

Zusammenhang zwischen der Systemempfindlichkeit einer guten Messung und dem Signal-Rausch-Verhältnis

Auswirkungen der Auswahl der Strahlenquelle

Zur Verdeutlichung werden wir einige Definitionen und statistische Begriffe vorstellen. Zu diesem Zweck verwenden wir eine Zielscheibe, wobei die Mitte den korrekten Wert darstellt. Jeder „Schuss auf die Scheibe“ steht für ein Messergebnis.

Statistische Fehler

Zufällige Fehler werden durch inhärent unvorhersehbare Schwankungen in den Messwerten eines Messgerätes oder in der Interpretation des Messwertes durch den Versuchsleiter verursacht. In jeder Messung gibt es solche zufälligen Fehler, die für eine angeblich gleiche, wiederholte Messung unterschiedliche Werte annehmen. Diese zufällig auftretenden Fehler werden als statistische Fehler bezeichnet und folgen typischerweise der Gaußschen Normalverteilung. Sie können daher mit statistischen Methoden gehandhabt werden.

Systematische Fehler

Systematische Fehler treten nicht zufällig auf und weisen unter konstanten Parametern ein reproduzierbares Muster auf. Bei einem ordnungsgemäßen Aufbau sind systematische Fehler vorhersehbar und typischerweise konstant oder proportional zum wahren Wert. Für radiometrische Messgeräte sind unter anderem die folgenden wesentlichen systematischen Fehler zu berücksichtigen:

Empfindlichkeitsänderungen aufgrund von Temperaturschwankungen oder Detektorkomponenten

Schwankungen der Zählrate aufgrund von Änderungen der natürlichen Hintergrundstrahlung (z. B. Radon)

Unvorhersehbare Störsignale durch Schweißnahtprüfungen oder andere Störungen

Falsche Kalibrierung

Temperatur- und Alterungseinflüsse

Zumindest einige systematische Fehler können durch den Einsatz erstklassiger Kompensationsverfahren reduziert werden. Dank ausgefeilter Algorithmen und Verfahren, die die Empfindlichkeit eines Detektors mittels Signalvergleich mit einer bekannten Referenz messen, können diese Effekte kompensiert werden. Eine solche automatische Verstärkungs- oder Hochspannungsregelung sollte im Messsystem integriert sein. Die von Berthold Technologies eingesetzten Algorithmen basieren beispielsweise auf einer Analyse des erhaltenen Spektrums vom verwendeten primären Radioisotop oder – noch ausgefeilter – der kosmischen Strahlung. So können diese Fehler auf nicht mehr als 0,1 % der erfassten Zählrate über einen Temperaturbereich von -60 °C bis +70 °C und über einen Zeitraum von mehr als 10 Jahren begrenzt werden.

Natürliche Hintergrundstrahlung

Wir sind immer einer natürlich vorkommenden Strahlung ausgesetzt, die hauptsächlich durch kosmische oder terrestrische Strahlung verursacht wird. Dies wird als „natürlicher Nulleffekt“ bezeichnet. Veränderungen der natürlichen Hintergrundstrahlung sind schwierig zu kompensieren. Bevor wir näher auf die Fehlerreduzierung eingehen, wollen wir uns zunächst diesen Effekt ansehen. Hintergrundstrahlung wird hauptsächlich durch kosmische oder terrestrische Strahlung verursacht. Während die kosmische Strahlung sehr konstant ist, kann die terrestrische Hintergrundstrahlung je nach geographischem Standort sehr unterschiedlich sein. Unterschiedliche geologische Gesteinsformationen bestehen aus unterschiedlichen Teilen an natürlich vorkommenden Radionukliden, was zu einer unterschiedlichen terrestrischen Hintergrundstrahlung führt.

Eines der wichtigsten natürlichen Radionuklide ist dabei das Edelgas Radon-222 (Rn-222) mit seinen Zerfallsprodukten. Rn-222 entsteht in Gesteinsformationen und gelangt aufgrund der physikalischen Eigenschaften eines Gases in die Erdatmosphäre, wo es eine messbare Menge an Radioaktivität in der Luft direkt über dem Boden verursacht. Regen kann ebenfalls zu einer vorübergehenden Erhöhung der Konzentration der Radonzerfallsprodukte am Boden und damit zu einer höheren Hintergrundstrahlung führen. Diese Änderungen der Hintergrundstrahlung wirken sich auf Stabdetektoren stärker aus als auf Punktdetektoren. Dies ist darauf zurückzuführen, dass Punktdetektoren häufig mit einem Kollimator zur Unterdrückung der Hintergrundstrahlung ausgestattet sind, während Stabdetektoren in der Regel nicht abgeschirmt sind und ein deutlich größeres Szintillatorvolumen aufweisen. Daher ist das Signal-Hintergrund-Verhältnis für Punktdetektoren typischerweise viel höher als für Stabdetektoren.

Störstrahlung

Eine weitere unvorhersehbare Ursache für Störungen sind laufende Schweißnahtprüfungen in der Anlage oder im Komplex. Typischerweise werden dafür Gammastrahler (z. B. Iridium-192) verwendet, die eine deutliche Erhöhung der Hintergrundstrahlung verursachen können. Dadurch ändert sich das Messsignal schnell und drastisch, was zu fehlerhaften Prozesswerten führt. Abhängig vom eingesetzten Messsystem kann das Signal wesentlich länger als die eigentliche Störung unterbrochen werden und sogar zu dauerhaften Schäden an den Detektorkomponenten führen. Geräte, die mit der Fremdstrahlungserkennung XIP (X-Ray Interference Protection) von Berthold ausgestattet sind, erkennen Fremdstrahlungen und frieren das Messsignal während der Störung ein. Noch ausgefeilter ist die Funktion Fremdstrahlungsunterdrückung RID (Radiation Interference Discrimination), die auf einem komplexen Algorithmus basiert. Dadurch wird es ermöglicht, zwischen Fremdstrahlung und der tatsächlichen, von einem im Messsystem eingesetzten Kobalt-60-Strahler emittierten, Zählrate zu unterscheiden.

Kalibrierung

Radiometrische Messgeräte arbeiten nach dem Prinzip der Absorption. Grundsätzlich interagiert jede Materie mit

γ-Strahlung und hat eine abschwächende Wirkung. Aus Sicht der Prozessmesstechnik zählen dazu nicht nur die zu messenden Medien, sondern auch Behälterstahlwände, jegliche Innenkonstruktion, Isolierung, Gerüst usw. Eine typische Delayed-Coking-Anlage in einer Raffinerie besteht beispielsweise aus Stahl mit einer Wandstärke von 20-50 mm und einem Durchmesser von 5-9 m, alles in Isolierung verpackt. Aus diesem Grund muss ein Füllstandsmesssystem vor Ort kalibriert werden, um die prozessunabhängige Abschwächung zu berücksichtigen. Eine Werkskalibrierung ist daher nicht möglich. Auch Systeme für Dichtemessungen müssen vor Ort mit mindestens einem Referenzpunkt bekannter Dichte kalibriert werden.

Typischerweise wird das Messsystem unter bekannten Prozessbedingungen kalibriert, z. B. im Fall einer kontinuierlichen Füllstandsmessung bei vollem und leerem Behälter oder für ein Dichtesystem mit mindestens einer bekannten Dichte der Flüssigkeit in der Rohrleitung. Obwohl eine korrekte Kalibrierung sehr wichtig ist, können besonders bei diesem Vorgang viele Fehler gemacht werden.

Typische Fehlerquellen sind:

Kalibrierung unter den falschen Bedingungen: Die Kalibrierung sollte so nah wie möglich an den realen Prozessbedingungen durchgeführt werden. Unterschiedliche Temperaturen, Gasdichten, laufende Rührwerke, Sprühdüsen usw. können die Abschwächung beeinflussen. Liegen während der Kalibrierung andere Bedingungen als während des eigentlichen Prozesses vor, entsteht dadurch ein systematischer Fehler.

Verwendung einer falschen Referenz: Die Kalibrierung eines Systems mit der Annahme eines leeren Behälters (0 % Füllstand), obwohl sich jedoch noch eine Produktmenge im Behälter befindet.

Bei Dichtemessungen sind Proben zur Bestimmung des Prozesswertes in der Kalibriertabelle nicht repräsentativ für den realen Zustand.

Erfassung der Kalibrierzählraten mit zu kurzer Messzeit – siehe auch Abschnitt „Statistische Fehler“.

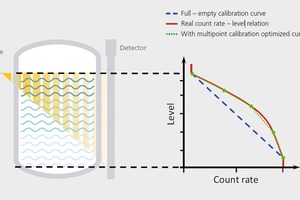

Selbst wenn die oben genannten Fehlerquellen nahezu ausgeschlossen werden können, liegt ein weiterer systematischer Fehler vor. Wird ein Stabdetektor zusammen mit einem Punktstrahler verwendet, so ist der Zusammenhang zwischen Zählrate und Füllstand nicht linear (längerer Strahlengang und größere effektive Wandstärken am unteren Ende des Messbereichs, vgl. Bild „Kalibrierkurve“). Falls das Messgerät nun eine gerade Linie (blau) als Kalibrierung verwendet, führt dies zu einer systematisch reduzierten Genauigkeit des Systems bei bester Reproduzierbarkeit. Mit anderen Worten, das System zeigt immer den gleichen Füllstand bei gleichen Prozessbedingungen an, jedoch mit einer Abweichung vom tatsächlichen Füllstand (rot). Eine Mehrpunkt-Kalibrierung kann verwendet werden, um die Kurve zu linearisieren, den systematischen Fehler zu reduzieren und somit die Genauigkeit der Messung zu verbessern (grün). Dennoch ist häufig die, aufgrund der nicht exakt linearen Messung, reduzierte Genauigkeit vernachlässigbar und die hohe Reproduzierbarkeit der Messung von entscheidender Bedeutung.

Sonstige prozess- und anwendungsbezogene Fehler

Neben den oben genannten unvermeidlichen, aber mit „Best Practices“ und Sorgfalt beherrschbaren, systematischen Fehlern gibt es mehrere prozess- und anwendungsbezogene Fehlerquellen. Diese werden oft unterschätzt und somit nicht berücksichtigt, können jedoch einen erheblichen negativen Einfluss auf die Genauigkeit der Messung haben. Diese Fehlerquellen müssen letztendlich vom Endnutzer der radiometrischen Messungen berücksichtigt werden und können nicht durch eine entsprechende Ausführung der Messgeräte selbst reduziert werden. Im Folgenden finden Sie eine Auswahl möglicher Quellen für prozess- und anwendungsbezogene Fehler:

Materialablagerungen an Bauteilen

Übersprechen

Wasserstoffgehalt

Schaumbildung

Gasblasen oder Gaseinschlüsse

Geschlossene Strahlerabschirmung

In Anbetracht all dieser Punkte ist offensichtlich, dass die Qualität einer radiometrischen Messung nicht nur von der Empfindlichkeit des Detektors abhängt, sondern auch von einer Reihe systematischer Fehler beeinflusst wird. Tatsächlich muss die Empfindlichkeit im Zusammenhang mit der Leistungsfähigkeit und Funktionalität des gesamten Systems gesehen werden. Ohne die richtigen Maßnahmen erhöht eine höhere Empfindlichkeit auch den gemessenen Nulleffekt und verbessert damit nicht unbedingt die Gesamtsystemleistung. Analogie zu unserem Beispiel mit dem Fernsehgerät: Mit einer Verstärkung des Signals wird auch das Rauschen verstärkt, was die Gesamtqualität des Systems nicht verbessert. Ziel sollte es daher sein, das Signal-Rausch-Verhältnis zu verbessern, anstatt sich nur auf die Empfindlichkeit zu konzentrieren.

Messaufgaben

Grenzschalter

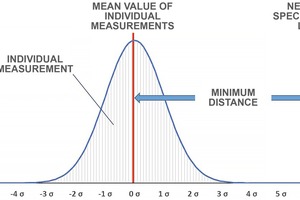

Ein Grenzschalter ist eine Punkt-zu-Punkt-Messung unter Verwendung eines Punktstrahlers und eines Punktdetektors. Systematische Fehler können durch entsprechende Sorgfalt bei der Installation und Inbetriebnahme der Messung sehr einfach reduziert werden. Dazu gehört auch die Verwendung der korrekt berechneten Schaltgrenzen. Der wichtigste und dominierende Fehler eines Grenzschalters ist der statistische Fehler. Diese Tatsache wird mittels statistischer Methoden gelöst, z. B. durch Einstellen einer geeigneten Zeitkonstante und Bilden eines vernünftigen Mittelwertes. Durch die Auslegung des Systems mit einer ausreichend hohen Zählrate und einer ausreichend großen Sigma-Differenz zwischen Leer- und Vollzählung wird ein Fehlschalten verhindert. Das Bild „Zuverlässige Schaltgrenzen” zeigt, dass für sichere Schaltvorgänge eine Differenz von mindestens 6 σ empfohlen wird. Zählraten, die aufgrund statistischer Schwankungen außerhalb 6 σ -Bandes liegen, treten bei 0,0000 001 973 % aller Messungen auf – nur alle 16 Jahre bei Anwendung typischer Detektoreigenschaften.

Dichte

Ähnlich wie Grenzschalter sind Dichtemessungen typischerweise Punkt-zu-Punkt-Messungen mit den gleichen Fehlermodi. Bei Dichtemessungen ist es wichtig, sorgfältig auf mögliche Ursachen für systematische Fehler zu achten. Wie bereits erläutert, stellen ausgefeilte Temperatur- und Alterungskompensationen die hohe Reproduzierbarkeit der Messung selbst sicher. Außerdem ist eine ordnungsgemäße Kalibrierung unerlässlich, da Probenahme und Labormessungen die Genauigkeit des Kalibrierwertes beeinflussen können. Bei der Messung selbst ist der statistische Fehler am dominantesten. In der Praxis stellt eine Dichtemessung hohe Anforderungen an Genauigkeit und Reproduzierbarkeit in einem sehr begrenzten Kalibrierbereich. Typischerweise ist das Verhältnis der Zählrate, gemessen bei der höchsten und der niedrigsten Dichte, klein und daher der akzeptable statistische Fehler recht gering, was die Verwendung ähnlicher Zählraten wie bei einem Grenzschalter verbietet. Um diesen statistischen Fehler zu handhaben ist es hilfreich, eine hohe Zählrate in Kombination mit einer langen Zeitkonstante einzusetzen.

Kontinuierlicher Füllstand

Während für Grenzschalter und Dichtemessungen die Punkt-zu-Punkt-Anordnung, unter Verwendung von Punktstrahlern und Punktdetektoren, dem Industriestandard entspricht, wird für kontinuierliche Füllstandsmessungen in der Regel mindestens ein stabförmiges Instrument eingesetzt. Wie bereits erwähnt, sind Stabdetektoren sehr anfällig gegenüber der natürlichen Hintergrundstrahlung, so dass die möglichen Fehler, die durch den Nulleffekt verursacht werden, mit Abstand dominieren. Die Empfindlichkeit einer radiometrischen Messung ist nicht automatisch ein Maß für deren Qualität. Es ist offensichtlich, dass der Nulleffekt und seine Schwankungen eine große Rolle spielen und dadurch verursachte Fehler das System dominieren können. Üblicherweise wird davon ausgegangen, dass das Halbieren der Aktivität den gleichen Effekt hat wie das Halbieren der Empfindlichkeit. Die Halbierung der Empfindlichkeit des Detektors ändert nichts am Gesamtfehler des Systems, vorausgesetzt, dass es kein anderes relevantes Störsignal wie das elektronische Rauschen gibt. Dies kann nur dann gewährleistet werden, wenn das Messgerät auf einem hohen Standard entwickelt und hergestellt wurde. Tatsächlich zeigen Berechnungen, dass das Signal-Rausch-Verhältnis der weitaus bessere Indikator für die Qualität eines Messsystems, ist und dieses Verhältnis durch Steuerung des Nulleffekts positiv beeinflusst werden kann.

Zusammenfassung

Wie in diesem Artikel ausgeführt wird, gibt es keine 100 %ig genaue Messung und für einen Benutzer gibt es viele potentielle Fallstricke. Einige dieser Fehlerquellen sind für die radiometrische Messung spezifisch und benötigen daher spezielle Vorkehrungen, bzw. können durch eine optimale Auslegung minimiert werden. Für eine gut funktionierende Messung ist es wichtig, geeignete Messmittel und die passende Konfiguration zu verwenden. Dazu gehört ebenso eine entsprechende Auslegung auf die korrekte und realistische Genauigkeit.

Bei radiometrischen Messungen hängt diese stark von der detektierten Strahlungsmenge und deren Interpretation ab. Um eine gute Messung zu erreichen, ist darüber hinaus eine gewisse Empfindlichkeit erforderlich. Diese ist aber nur ein Teil der Gleichung und eine Art Vorbedingung. Zu beachten ist hierbei, dass ein empfindliches System auf jede Gammastrahlung reagiert – also auch auf Hintergrundstrahlung, die störend auf die Messung wirken kann. Als Hintergrundstrahlung bezeichnet man unter anderem die immer vorkommende terrestrische oder kosmische Strahlung, die vom Detektor ebenfalls erfasst wird und natürlichen Schwankungen unterliegt. Durch korrekte Auslegung und Verwendung geeigneter Messgeräte kann die Hintergrundstrahlung jedoch beherrscht werden. Für Punktdetektoren hat die Empfindlichkeit in der Regel einen höheren Effekt auf die Qualität der Messung, da hierbei die Hintergrundstrahlung sehr gut durch Kollimatoren ausgeblendet werden kann. Für Stabdetektoren dagegen wird die Hintergrundstrahlung zu einem dominierenden Faktor und die Empfindlichkeit kann nicht als maßgebliches Qualitätsmerkmal dienen.

Daher ist es wichtiger, das System ganzheitlich zu betrachten, als sich ausschließlich auf die Empfindlichkeit zu konzentrieren. In diesem Artikel wird anhand einer exemplarischen Berechnung aufgezeigt, dass eine Halbierung der Empfindlichkeit nahezu keinen Einfluss auf die Messgenauigkeit hat. Daran wird deutlich, dass das Signal-Rausch-Verhältnis ein viel besserer Indikator für die Qualität eines radiometrischen Messsystems ist. Hier können die Experten von Berthold mit ihrer überlegenen Technologie präzise und zuverlässige Messungen liefern. Der Betreiber profitiert von der hohen Prozesssicherheit, einer optimalen Produktivität und kann ungeplante Ausfallzeiten vermeiden.